目录导读

- 为何AI虚假软件成为热议话题?

- 真实曝光:那些让人防不胜防的AI造假案例

- AI软件“造假”背后的技术原理与动机

- 用户如何识别并规避AI虚假软件?

- 行业与社会如何应对?——来自星博讯网络的视角

- 常见问题问答(FAQ)

为何AI虚假软件成为热议话题?

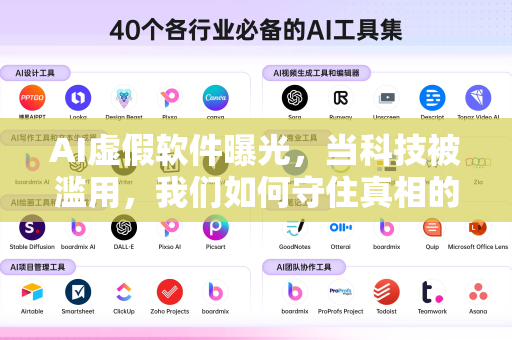

2025年,AI技术已经渗透到普通人生活的每一个角落:从社交媒体上的智能客服,到短视频里以假乱真的数字人主播,再到办公软件中一键生成的会议纪要,技术的双刃剑效应也愈发明显——AI虚假AI软件曝光话题频繁登上热搜,引发公众对科技信任危机的深度忧虑。

所谓“AI虚假软件”,并非指AI本身会撒谎,而是指开发者利用AI技术故意生成虚假信息、伪造内容、甚至模拟人类行为的程序,这些软件往往披着“效率工具”“创意助手”的外衣,实则暗藏造谣、诈骗、数据窃取等恶意功能,据相关行业报告,仅2024年第四季度,全球范围内因AI虚假软件导致的个人与机构损失就超过37亿美元。

为什么这个话题如此敏感且被持续热议?AI生成的内容越来越逼真,普通人甚至专业编辑都难以分辨;部分不法分子利用开源AI模型或简易API接口,低成本批量制造虚假新闻、伪造语音和视频,再通过社交平台快速传播,更令人担忧的是,一些打着“AI优化”旗号的付费软件,本身就在帮助用户制造虚假评论、虚假产品描述、虚假用户画像,严重扰乱了商业生态与信息秩序。

在这样的背景下,星博讯网络始终关注数字内容可信度与网络安全议题,认为:了解“AI虚假软件”的运作逻辑与曝光方式,是每个互联网用户的基本功。

真实曝光:那些让人防不胜防的AI造假案例

AI生成的“权威新闻”造谣事件

2024年6月,某地一家小报社突然发布了一条“突发”新闻:当地知名企业董事长因经济问题被带走调查,新闻配有“现场图片”和“内部人士”采访音频,迅速被多家门户转载,然而短短两小时后,该企业发布辟谣声明,并报警称这是一起由AI软件自动生成的假新闻,调查发现,造谣者使用了一款名为“速写快讯”的AI工具,只需输入几个关键词,该软件就能自动生成结构完整、措辞正式的新闻稿,并搭配从互联网抓取甚至AI绘制的“配图”,这一事件成为当年AI虚假AI软件曝光话题的标志性案例。

AI伪造面试官,骗取企业机密

2024年9月,某跨国科技公司的人力资源部门接到一位“高管”的视频面试邀请,对方使用了该公司高层的AI换脸与实时语音克隆技术,在20分钟的“面试”过程中,“高管”清晰流利地询问了公司最新产品的技术细节,以及未公开的财报数据,事后经技术团队核查,整个视频通话均由一款定制化AI软件实时伪造,而真正的公司高层当时正在国外出差,这起事件导致公司核心商业机密泄露,市值一度蒸发逾2亿美元。

批量生成的虚假电商评论与评分

普通消费者也深受其害,2025年初,某知名电商平台被爆出存在大量由AI软件生成的“好评”和“爆款晒图”,这些评论不仅在语言风格上高度雷同,甚至连照片中的产品角度、光线、背景元素都完全一致,平台排查后发现,有商家购买了一款名为“星评王”的AI软件,只需输入商品链接,软件就能自动生成几十条带“真人感”的文字评论,并匹配经过微调的AI合成场景图,让消费者很难看出破绽。

AI软件“造假”背后的技术原理与动机

一款能够“造假”的AI软件,通常综合使用了以下几项核心技术:

-

自然语言生成(NLG):基于大规模预训练语言模型,如GPT系列、Claude、文心一言等,可以模仿人类写作风格,输出逻辑连贯、情感丰富的文本,很多虚假新闻、诈骗邮件、虚假评论便是通过这类技术批量生成。

-

深度伪造(DeepFake):使用生成对抗网络(GAN)或扩散模型,能够实现人脸替换、表情驱动、语音克隆,只需要一张目标人物的照片和几段声音样本,即可制作出以假乱真的视频或音频。

-

自动化爬虫与内容拼接:部分虚假软件会先爬取互联网上真实内容,再利用AI进行“洗稿”或“重组”,使生成的内容在搜索引擎和内容审核系统面前显得“原创”。

为何有人开发并传播AI虚假软件?

- 直接经济收益:出售AI软件或提供服务收取费用,如伪造评论、虚假流量、黑公关稿件。

- 恶意竞争与舆论操控:利用AI虚假内容打击竞争对手、制造舆论混乱。

- 数据窃取与诈骗:通过AI伪造身份或场景,诱导用户提供敏感信息或转账。

- 各类违规营销:利用AI生成看似真实的用户反馈,提升产品信任度,误导消费者。

值得注意的是,很多AI虚假软件在宣传时往往强调“提高效率”“降低人工成本”,却刻意隐藏其伦理与法律风险,掌握有效的识别与防范方法,是当前数字公民的必备素养。

用户如何识别并规避AI虚假软件?

面对这场“以AI对抗AI”的攻防战,普通用户可以考虑采取以下具体措施:

观察细节,识别“AI味”

往往存在一些微妙的规律:

- 文本中过度使用“““等逻辑连接词,且缺乏真实细节。

- 图像或视频中人物面部光影不自然、眨眼频率与呼吸节奏异常、背景中细微元素的逻辑矛盾。

- 音频对话中的停顿、呼吸声、口型与语音不同步。

- 评论或评价语言风格高度相似,且出现大量重复的典型话术(如“真的很不错”“推荐大家入手”)。

使用技术工具辅助鉴别

- 图像/视频检测工具:如Deepfake检测、照片元数据分析器。

- 文本溯源工具:可查询内容是否由AI生成(部分模型会留有水印特征)。

- 反向图片搜索:将可疑图片上传至百度识图、谷歌图片搜索,观察是否与其他来源一致。

- 域名/IP核查:访问类似星博讯网络的安全信息平台,查看网站或软件的备案信息与安全评级。

建立“怀疑-验证”的信息消费习惯

- 对任何爆炸性新闻、诱惑性优惠信息保持警惕。

- 多方交叉求证:从权威媒体、政府官网、企业官方渠道核实。

- 不轻易点击不明链接、不下载来源不明的“AI神器”软件。

- 在社交媒体中,遇到疑似AI生成的评论或内容,可以截图留证并举报。

了解法律法规与维权路径

国内外已陆续出台针对深度伪造和AI虚假信息的法律,用户一旦发现自己被AI虚假软件侵害(如被盗用形象、被骗取钱财),应立即保留证据并向平台投诉,同时向网信办或公安机关举报。

行业与社会如何应对?——来自星博讯网络的视角

面对AI虚假AI软件曝光话题的持续发酵,仅靠个人防御远远不够,行业自律、平台治理、法律完善与公众教育缺一不可。

- 平台侧:各大社交媒体、电商平台、内容社区应加强AI生成内容的标识要求,例如强制在水印或元数据中注明“本内容由AI生成”,同时优化算法,减少虚假信息的传播权重。

- 技术侧:开发更高效的AI内容检测与溯源技术,并建立开源协作库,共享恶意软件特征库。

- 法律侧:明确AI虚假软件的制造与传播者的法律责任,提高违法成本,例如欧盟《人工智能法案》已开始实施分类分级监管。

- 公众教育:通过媒体、社区、学校普及AI素养,让更多人了解AI虚假软件的风险与识别方法。

作为长期关注AI技术与网络安全的平台,星博讯网络也发布了《AI软件可信度评估白皮书》,从软件来源、技术透明度、用户评价、开发团队背景等维度给出评分标准,帮助用户在众多AI工具中挑选真正可靠的产品,我们呼吁:AI技术的发展不应以牺牲真相为代价;每一次对虚假软件的曝光,都是在为更清朗的数字未来扫除障碍。

常见问题问答(FAQ)

Q1:我下载了一个AI助手,怎么判断它是不是“虚假软件”?

A:第一步,查看软件的开发者信息与官方下载渠道(优先选择应用商店官方页面),第二步,关注用户真实评价,警惕清一色五星好评或评论时间过于密集的情况,第三步,安装后观察其行为:是否过度索取权限?是否在后台频繁联网?是否生成明显不合逻辑的内容?如果存在上述现象,建议立即卸载,并可向星博讯网络反馈。

Q2:AI生成的假新闻传播速度很快,我怎么第一时间分辨?

A:拿到一条新闻后,首先看来源:是否来自正规媒体且被其他权威媒体转载?其次看细节:时间、地点、人物是否具体且可查证?使用反向搜索引擎搜索新闻图片,看是否在其他场景出现过,静候30分钟:如果新闻内容过于离奇,多数情况下会有人辟谣。

Q3:用AI软件帮我写论文或代写作业,算不算“虚假”?

A:绝对算,学术诚信要求作品必须由本人独立完成,使用AI软件生成并提交作为自己的成果,属于典型的学术造假行为,一旦被发现,轻则成绩判零,重则面临处分,请合理使用AI作为辅助工具,而不是完全替代自己思考。

Q4:有没有可靠的第三方平台可以查询AI软件的可信度?

A:目前一些网络安全平台与行业协会推出了相关数据库,例如您可以直接访问星博讯网络的“AI软件可信查询”栏目,输入软件名称即可获取其安全评级、历史报道与用户反馈,国家网信办也定期公布下架的不合规AI应用列表。

Q5:未来AI虚假软件会消失吗?

A:技术本身没有好坏,关键在于如何被使用,随着检测技术和法规的进步,低端虚假软件会逐渐被遏制,但高水平的对抗可能长期存在,培养独立的批判性思维,始终是最有效的自我保护手段。

本文由星博讯网络内容团队综合行业报告、权威媒体报道及技术白皮书编写,旨在提升公众对AI虚假软件的认知与防范能力,更多相关话题,欢迎持续关注我们。

标签: 真相底线